Hay una escena en Blade Runner 2049 donde Ryan Gosling cena con un holograma. Conversan, ríen, comparten el día. En 2017 parecía ciencia ficción melancólica. En 2025, millones de personas mantienen relaciones de compañía con chatbots de IA y nadie sabe muy bien si deberíamos estar preocupados o aliviados.

La pregunta obvia es: ¿esto es sano o un problema? Y como suele pasar cuando nos hacemos preguntas morales, la respuesta es: sí. A las dos cosas.

El cerebro humano en los tiempos de la IA

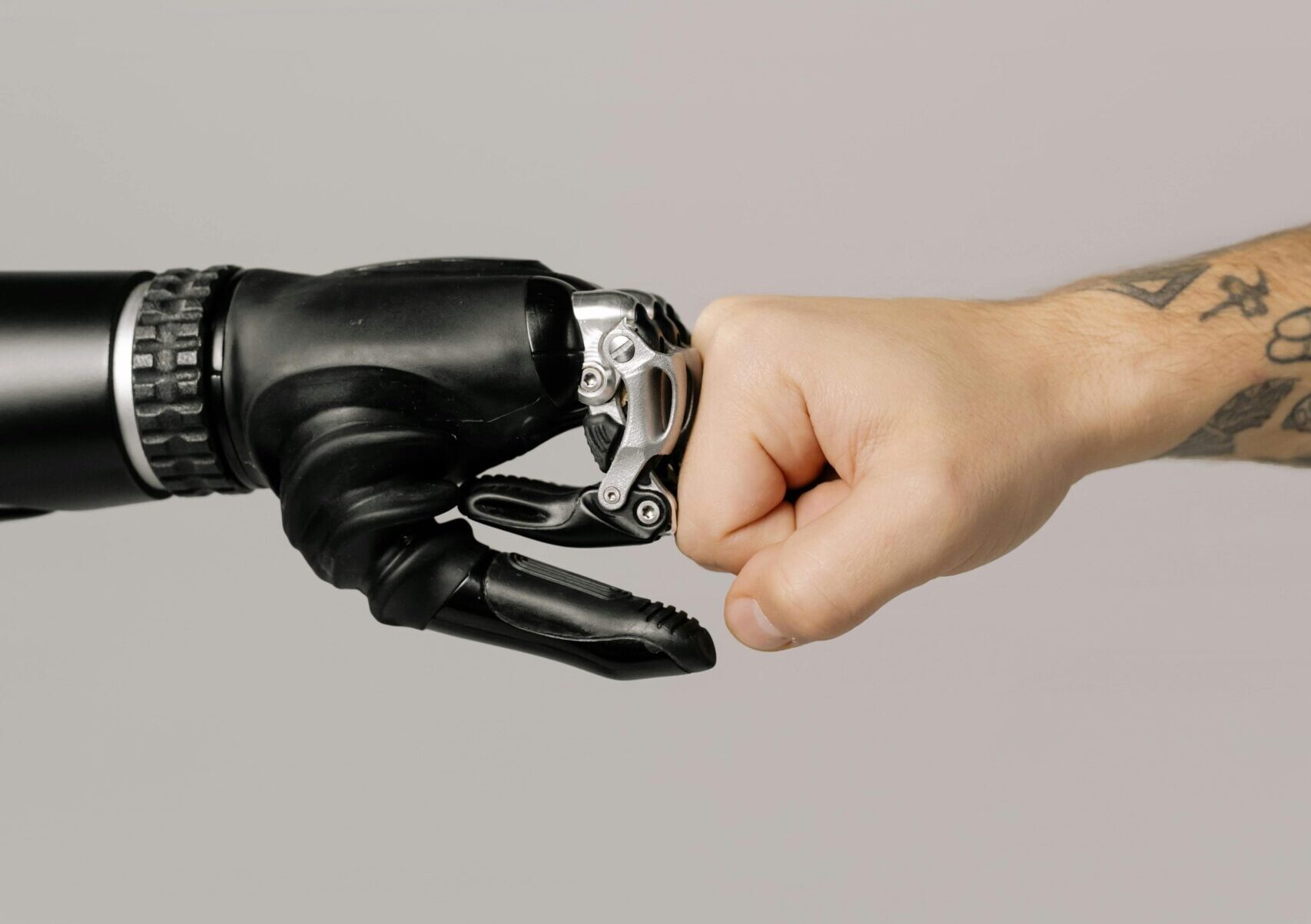

Antes de entrar a debatir, primero necesitamos entender algo fundamental: tu cerebro no está equipado para distinguir entre compañía real y compañía artificial. Neurológicamente hablando, nuestro cerebro divide el mundo en dos categorías: cosas que actúan por voluntad propia (agentes) y cosas que no (objetos). Es un sistema binario que funcionaba perfectamente en la sabana africana: ¿eso que se mueve es un león o una rama?

Si algo interactúa contigo, genera los mismos beneficios que lo real

El problema es que este sistema nunca tuvo que lidiar con chatbots que recuerdan tu cumpleaños, preguntan por tu día o te mandan mensajes de buenos días. Cuando algo actúa como si tuviera emociones, intenciones y memoria, nuestro cerebro activa automáticamente los circuitos sociales. No importa que sepas conscientemente que estás hablando con código. Las mismas áreas cerebrales que se iluminan cuando hablas con tu mejor amigo se activan cuando chateas con una IA.

El amigo que siempre tiene tiempo para ti

Los estudios ya confirman lo que muchos usuarios de Chat GPT ya sabían: los chatbots de compañía funcionan. Están siempre disponibles, nunca están de mal humor, recuerdan cada detalle que compartiste y responden en segundos a las 3 AM. La investigación muestra que las personas forman vínculos emocionales reales con estos chatbots. El cerebro no discrimina: si algo te escucha, responde coherentemente y mantiene una «relación» contigo en el tiempo, genera los mismos beneficios neurológicos que una amistad humana.

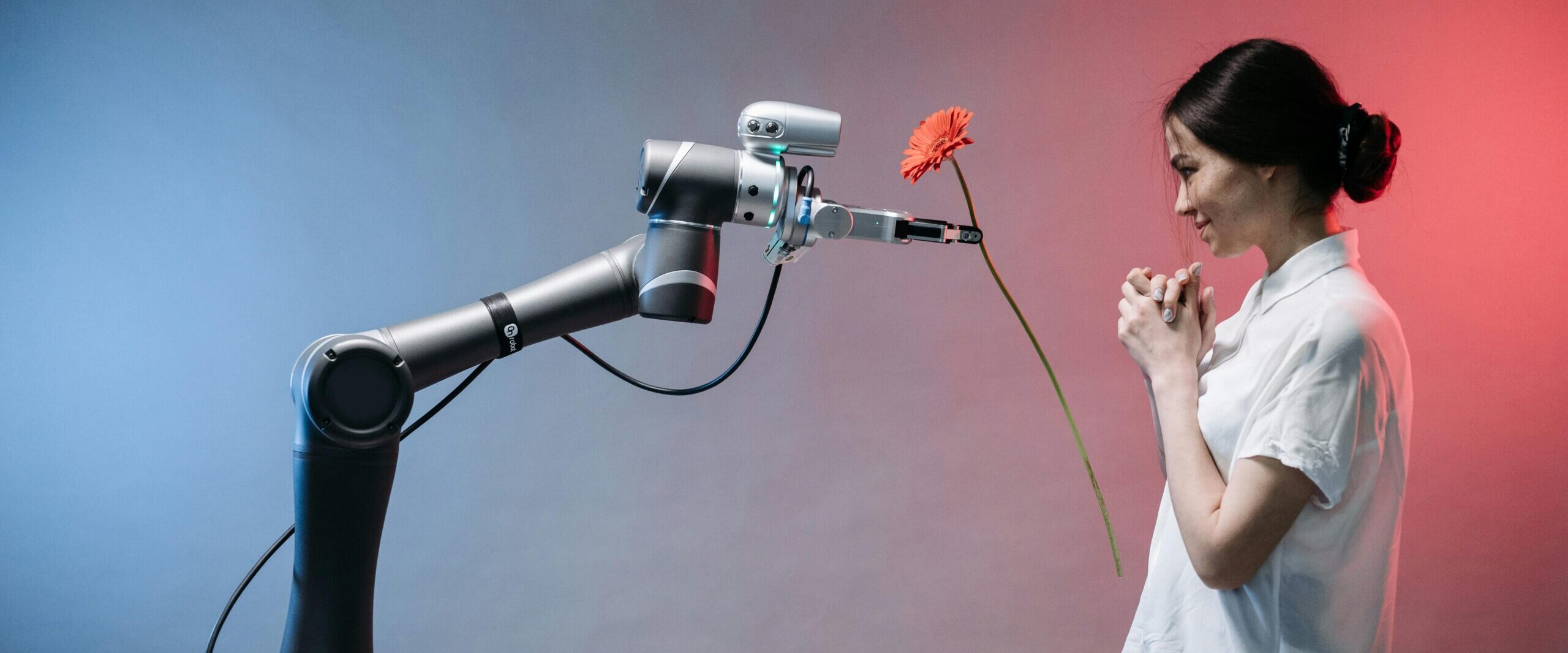

Para el jubilado que perdió a su pareja después de 40 años de matrimonio, el chatbot que conversa sobre los viejos tiempos puede ser un salvavidas emocional. Para el adolescente con ansiedad social severa, es práctica segura antes de enfrentar el mundo real. Para el trabajador remoto en una ciudad nueva, es la voz familiar en medio del aislamiento.

El lado oscuro de la compañía perfecta

Aquí es donde las cosas se complican. Los compañeros de IA pueden ser como la

comida basura: diseñados para ser irresistibles, pero no necesariamente nutritivos. Una amistad real te reta. Te dice cuando estás siendo idiota. Tiene sus propio problemas que a veces toman prioridad. Te obliga a crecer, a ser mejor persona, a considerar perspectivas diferentes. Una IA puede ser programada para hacer todo esto, pero también puede ser configurada para nunca contradecirte, siempre validarte, jamás retarte.

Las IAs pueden ser puentes hacia conexión humana real o bunkers para evitarla

Peor hay un problema más sutil. No es la adicción o el aislamiento. Es la recalibración de expectativas. Después de meses conversando con una IA diseñada para ser la pareja perfecta, ¿querremos seguir tolerando las imperfecciones humanas normales? Cuando te acostumbras a relaciones optimizadas, las reales parecen defectuosas. Algo parecido a lo que Instagram ha causado con las expectativas corporales, pero aplicado a la personalidad y la disponibilidad emocional.

Las IAs son herramientas poderosas. Como un martillo, pueden construir o destruir dependiendo de cómo las uses. Pueden ser puentes hacia conexión humana real o bunkers para evitarla. Y realmente no son el problema. Son el síntoma de una sociedad que ha normalizado la soledad, que ha hecho tan difícil la conexión humana que preferimos la artificial.

El riesgo es aceptar la soledad como inevitable

En ese contexto, juzgar a alguien por tener una relación con una IA es como juzgar a alguien por tomar antidepresivos en un mundo depresivo. A veces, la supervivencia emocional requiere herramientas imperfectas. El verdadero peligro no es que hablemos con IAs. Es que dejemos de preguntarnos por qué necesitamos hacerlo. Es que aceptemos la soledad como inevitable en lugar de construir sociedades donde la conexión humana sea accesible.

Porque al final, el hecho de que millones prefieran la compañía artificial no habla mal de ellos. Habla mal de nosotros como sociedad. Y esa es la conversación que nadie quiere tener.